Reagire al velleitarismo #185

Dalla disinformazione dei chatbot ai batteri-computer, passando per le nuove abitudini di viaggio e l'IA applicata nel conflitto a Gaza.

Chatbot e disinformazione

Un anno di monitoraggio ha mostrato un dato preoccupante: la percentuale di risposte dei chatbot contenenti informazioni false è raddoppiata. Non solo piccoli errori, ma contenuti che possono influenzare il dibattito pubblico e alimentare fake news. L’indagine richiama l’urgenza di trasparenza sugli algoritmi e controlli più rigorosi.

Leggi l’articolo su Newsguard.

Alta velocità e abitudini di viaggio

In Italia i treni AV non sono soltanto un mezzo rapido: stanno cambiando le scelte di mobilità dei cittadini. Sempre più persone preferiscono il treno ad auto e aerei, anche per tratte intermedie. Un fenomeno che impatta su sostenibilità, economia e organizzazione dei trasporti nazionali.

Ne parla la newsletter Campanili

L’affidabilità dei chatbot medici

In Cina c'è chi ha scelto di affidarsi a un chatbot medico, DeepSeek, trovandolo “più umano” dei dottori reali. Ma le risposte dell’AI, spesso imprecise, mostrano i limiti della tecnologia e di sistemi sanitari incapaci di reggere l’isolamento e la fragilità dei pazienti.

Viola Zhou su Rest of World

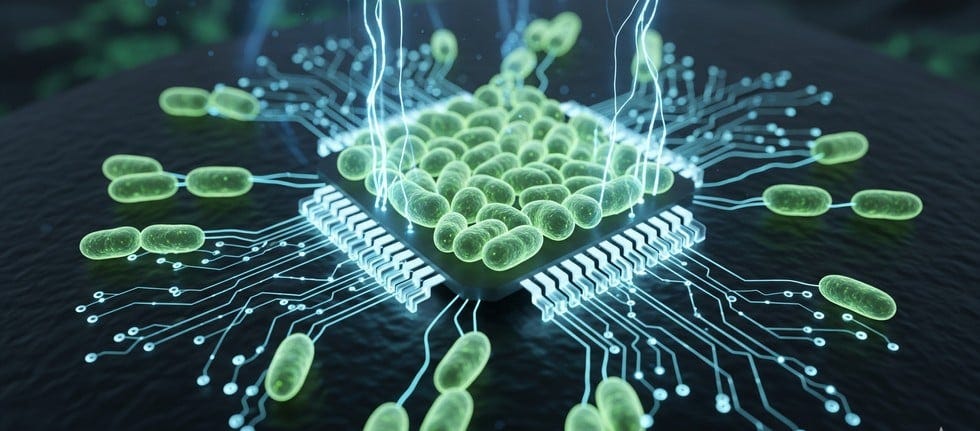

Batteri come computer viventi

La bioinformatica esplora scenari inediti: batteri programmabili come sistemi di calcolo biologici. Questi microrganismi potrebbero memorizzare informazioni, elaborare dati e persino prendere decisioni. Una tecnologia che apre a potenziali applicazioni in medicina, ambiente e robotica.

Gaza, laboratorio dell’IA e dei suoi bias

Il conflitto israelo-palestinese diventa un banco di prova per l’uso militare dell’intelligenza artificiale. L’analisi mette in guardia dai bias negli algoritmi, che rischiano di amplificare discriminazioni e violenze invece di ridurle. Gaza è così il simbolo dei pericoli di un’IA applicata alla guerra.

Franco Padella su Sbilanciamoci.